OpenAI는 NVIDIA 가속기의 추론 효율성에 의문을 품고 있으며 적극적으로 대체품을 찾고 있습니다

AI 기술 세계에서 일어나는 일

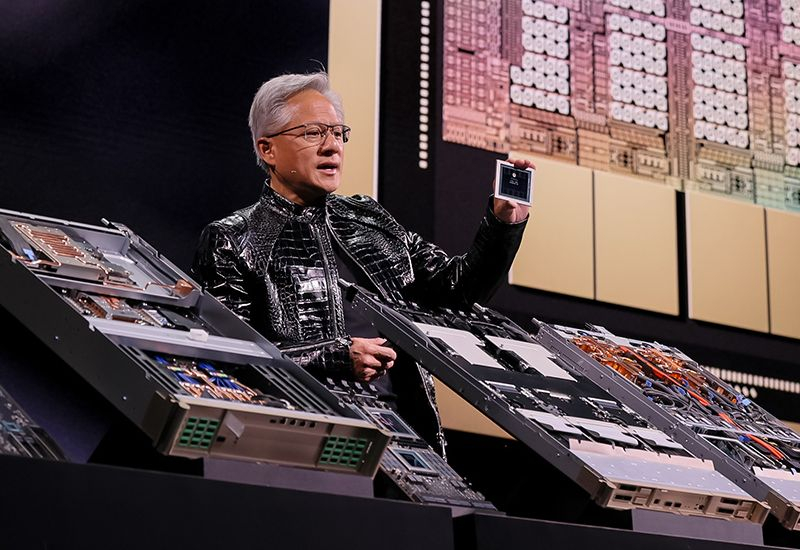

핵심 플레이어 OpenAI와 Nvidia는 인공지능 시장의 리더로 여겨지지만 새로운 파트너를 찾고 있습니다. 곧 이들 회사 간에 1억 달러 규모의 계약이 체결될 것으로 예상됩니다.

Nvidia 가속기 문제

현재 Nvidia 칩은 이미 학습된 모델을 사용하는 추론(인퍼런스)에서 항상 필요한 성능을 제공하지 못합니다. OpenAI는 대안을 찾고 있습니다.

새로운 솔루션 개발 방식

1. OpenAI → Cerebras + Groq

- 회사는 인퍼런스에 더 적합한 외부 공급업체 칩으로 가속기 10%를 교체하려 합니다.

- Cerebras와의 파트너십이 이미 체결되었습니다: OpenAI는 그들의 “왕-가속기”를 구매해 대형 언어 모델 처리에 탁월합니다.

2. Groq 및 Nvidia

- 지난해 Nvidia는 2000만 달러에 Groq를 인수했으며, 더 유리한 거래 구조를 제안했습니다.

- 인수 이후 Groq는 일부 자율성을 잃었고, 대부분의 가속기 개발자는 Nvidia 사내로 이동했으며, 나머지 회사는 이제 클라우드 시스템용 소프트웨어만 판매할 수 있습니다.

3. AMD 및 기타 옵션

- OpenAI는 아직도 HBM 외부 메모리를 사용하는 Nvidia와 AMD 가속기에 크게 의존하고 있습니다.

- 인퍼런스에 적합한 칩은 대형 통합 메모리를 갖춘 것이며, Groq, Cerebras, Google이 이러한 칩을 제공합니다.

왜 이 모든 것이 중요한가

- 인퍼런스 효율성은 ChatGPT, Codex와 같은 대형 언어 모델 운영에 필수적입니다.

- Codex 문제 – AI 에이전트 개발 중 OpenAI는 Nvidia 가속기의 비효율성을 겪었으며, 이는 하드웨어 플랫폼 전환의 필요성을 강조합니다.

- 향후 대안 – OpenAI는 Cerebras 솔루션과 다른 칩을 사용해 개발자 도구 성능을 높일 계획입니다.

결론

OpenAI는 Nvidia에 완전히 의존하지 않기 위해 새로운 기술 파트너를 적극적으로 찾고 있습니다. 동시에 스타트업(Cerebras, Groq)에 대한 투자 전략을 수립하고, Nvidia와의 대형 거래 및 최대 1억 달러 규모의 잠재적 투자를 검토 중입니다. 이는 인퍼런스를 개선하고 AI 제품 개발 속도를 높이는 데 도움이 될 것입니다.

Asted Cloud

Asted Cloud

댓글 (0)

의견을 남겨 주세요. 예의를 지키고 주제에서 벗어나지 말아 주세요.

댓글을 남기려면 로그인