Nvidia는 Groq 3 LPU 칩을 출시했으며, 이는 AI 모델 추론을 토큰 수준으로 가속화합니다.

Nvidia가 Vera Rubin 플랫폼의 새로운 기능을 공개합니다

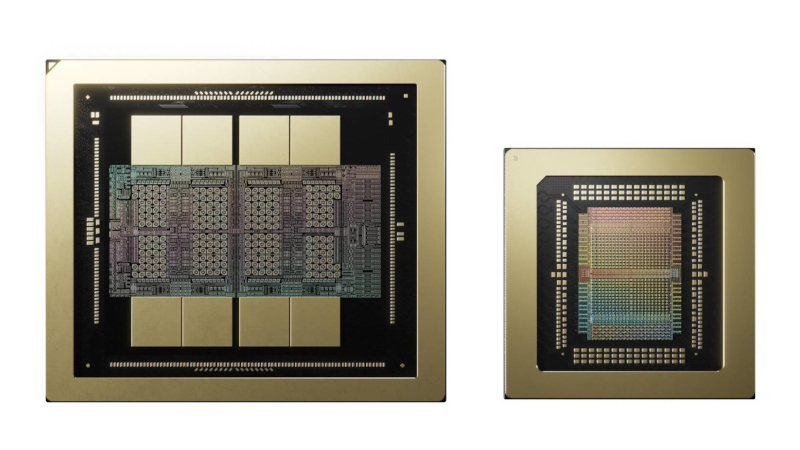

올해 GTC 컨퍼런스에서 Nvidia CEO 젠센 황은 Vera Rubin 플랫폼 확장에 대해 발표했습니다. 새로운 기능의 기반은 Groq 회사로부터 인수한 지적 재산이며, Rubin에는 *Groq 3 LPU* 칩이 포함되었습니다 – 토큰을 고속으로 낮은 지연 시간으로 제공하도록 설계된 추론 가속기입니다.

Vera Rubin에 이미 있는 것들

플랫폼은 Nvidia가 스탠드얼론 시스템으로 모으고 대형 AI 공장으로 확장하는 여섯 가지 핵심 구성 요소로 이루어져 있습니다:

| 구성요소 | 설명 |

|---|---|

| GPU Rubin | 288 GB HBM4 비디오 카드 |

| CPU Vera | 중앙 처리 장치 |

| NVLink 6 | 내부 시스템 확장 시스템 |

| ConnectX‑9 | 지능형 네트워크 어댑터 |

| BlueField‑4 | 데이터 처리 프로세서 |

| Spectrum‑X | 통합 광학을 갖춘 시스템 간 스케일링 스위치 |

Groq 3 LPU는 대규모 시스템 배포 시 사용되는 새로운 빌딩 블록으로 추가되었습니다.

Groq 3 LPU가 돋보이는 이유

주요 차이점은 메모리 아키텍처입니다. 대부분의 가속기는 작업 메모리로 HBM을 사용하는 반면, 각 Groq 3 LPU는 500 MB SRAM을 포함합니다. 비교:

| 매개변수 | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| 용량 | 288 GB | 0.5 GB |

| 대역폭 | ~22 TB/s | 150 TB/s |

추론 작업에서 대역폭에 민감한 경우 SRAM의 이점이 명확합니다. 바로 그 이유로 Nvidia는 Groq 3을 Rubin에 포함시켜 토큰 발행 속도를 높였습니다.

Groq 3 LPX 스탠드

스탠드에는 256개의 Groq 3 LPU 칩이 장착되어 있으며, 이는 다음과 같은 성능을 제공합니다:

- 128 GB SRAM

- 총 대역폭 40 PB/s

- 내부 인터페이스 대역폭 640 TB/s

하이퍼스케일 솔루션 부사장 Ian Bak은 이 스탠드를 Rubin용 공동 프로세서라고 불렀으며, 모델의 각 레이어와 토큰에서 디코딩 성능을 향상시키는 역할을 강조했습니다.

멀티 에이전트 시스템에 미치는 영향

Bak은 Groq 3 LPX가 미래 AI 시장 – 멀티 에이전트 시스템 –의 핵심 요소가 될 것이라고 언급했습니다. 에이전트가 챗봇 대신 직접 데이터를 교환할 때, 반응 요구 사항이 변합니다: 초당 100 토큰에서 1,500+ 토큰 이상으로.

경쟁자와 전망

텍스트에는 Wafer‑Scale Engine (WSE)을 사용하여 대규모 SRAM을 갖춘 낮은 지연 추론을 제공하는 Cerebras가 경쟁자로 언급되었습니다. OpenAI는 이미 Cerebras를 선도 모델에 활용해 유리한 지연 시간을 얻고 있습니다.

Bak은 또한 Groq 3 LPU의 등장으로 Rubin CPX 가속기에 대한 의존도를 낮출 수 있다고 말했습니다. 현재 Nvidia는 Groq 3 LPX 스탠드를 플랫폼과 통합하는 데 집중하고 있으며, 두 칩 모두 대용량 GDDR7 메모리 없이 추론을 강화하도록 설계되었습니다.

결론:

새로운 Groq 3 LPU 칩과 LPX 스탠드는 Vera Rubin의 낮은 지연 추론 부문을 강화하며, 더 빠른 멀티 에이전트 AI 시스템으로 가는 길을 열고 Cerebras와 같은 경쟁자와 경쟁합니다.

Asted Cloud

Asted Cloud

댓글 (0)

의견을 남겨 주세요. 예의를 지키고 주제에서 벗어나지 말아 주세요.

댓글을 남기려면 로그인