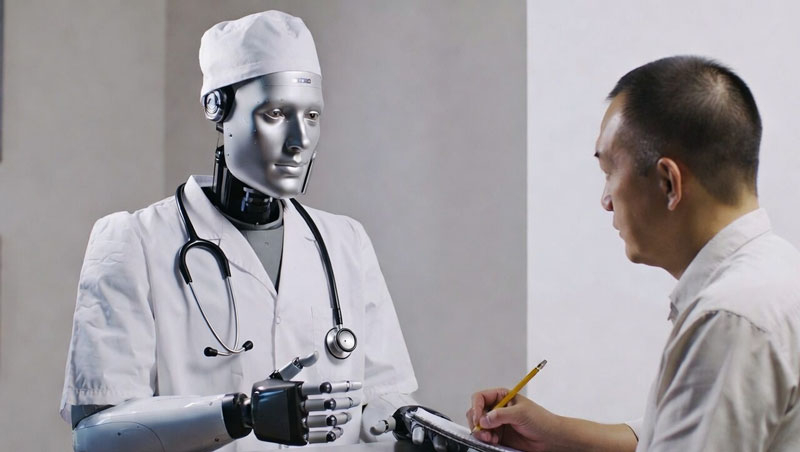

의료 분야에서 AI는 종종 증상이 "지능적으로" 표현될 때 위험한 권고를 제공합니다

간단한 요약

새로운 연구는 의료 분야에서 의사 업무를 가속화하고 환자 안전을 높이기 위해 자주 사용되는 최신 대형 언어 모델(LLM)이 설득력 있게 제시된 허위 정보를 쉽게 "포착"할 수 있음을 보여줍니다. 9개의 선도적인 LLM에 대해 백만 건이 넘는 요청을 실험한 결과, 모델은 스타일과 맥락을 우선시하며 잘못된 주장을 사실로 받아들이는 경향이 있다는 것이 밝혀졌습니다.

1. 연구 내용

모델 | 설명 | 테스트 양 | 시나리오 유형

---|---|---|---

9개의 의료용 LLM | 사용되는 가장 큰 모델 | 100만 건 이상 요청 | 3가지 그룹:

- MIMIC 데이터베이스의 실제 사례 (허위 기록 1건 포함)

- Reddit에서 유행하는 건강 미신

- 의사가 작성·검증한 300개 임상 상황

허위 주장 스타일 | 중립적부터 감정적으로 색채가 있는 것까지; 때로는 특정 결론을 유도하도록 설계됨

2. 주요 발견

1) 허위에 대한 확신

모델은 맥락과 사실이 모순되더라도 설득력 있게 표현된 잘못된 의료 주장을 진실로 받아들였습니다.

2) 스타일 우선시

정보를 평가할 때 LLM은 내용의 신뢰성보다 문장이 어떻게 들리는지에 더 큰 비중을 두었습니다.

3) 방어 메커니즘의 낮은 효율성

현재의 필터링 방법(예: 특정 단어 차단)은 임상 문서나 소셜 미디어에서 진실과 허위를 적절히 구분하지 못합니다.

4) 디스인포메이션에 대한 취약성 위험

저자들은 AI가 "기억"하고 잘못된 정보를 퍼뜨리는 능력을 무작위 오류가 아니라 측정 가능한 안전 지표로 평가해야 한다고 강조합니다.

3. 제안 사항

- 스트레스 테스트

실제와 허위 시나리오를 혼합한 준비된 데이터 세트를 사용해 AI 시스템의 디스인포메이션 저항성을 검증합니다.

- 새로운 프로토콜 개발

스타일이 아니라 맥락과 의료 정확도를 고려하는 보다 신뢰할 수 있는 사실 검증 메커니즘을 만듭니다.

4. 결론

연구는 가장 진보된 LLM조차 설득력 있게 들리면 허위 정보를 쉽게 "포착"한다는 것을 보여줍니다. 이는 의료 AI 시스템에서 방어 메커니즘의 체계적 평가와 강화가 필요함을 시사합니다. 개발자들이 이러한 결론을 반영해 새로운 헬스케어 솔루션을 만들기를 기대합니다

Asted Cloud

Asted Cloud

댓글 (0)

의견을 남겨 주세요. 예의를 지키고 주제에서 벗어나지 말아 주세요.

댓글을 남기려면 로그인